SHOWA会 「生成系AIがもたらす変化 ChatGPTで何ができる?」~生成系AIを使う目的はコスト削減

株式会社ショーワのユーザー会SHOWA会は6月19日、東京都千代田区西神田のショーワ本社セミナールームとオンラインのハイブリッドで40期第4回講演会を開催した。当日はブライター・レイターの山下潤一郎氏を講師に迎え、「生成系AIがもたらす変化 ChatGPTで何ができる?」をテーマに行った。

山下氏は、生成系AI「ChatGPT」を中心に生成系AIの基礎や使用上の注意などを紹介すると共に、生成系AIを用いて出来ることや懸念点について述べた。セミナー内容から紹介する。(文責 編集部)

対話形式の応答に特化した「ChatGPT」

生成系AIの一つ、「ChatGPT」は、OpenAIが開発した大規模な言語モデル。2022年11月30日(米国時間)に公開され、これまでのAIとは違う整合性の取れた回答などから大きな話題を呼んだ。「Chat」は、その名の通り、やり取りを意味し、「GPT」は、「Generative Pre-trained Transformer」の略で、トランスフォーマーと呼ばれるニューラルネットワークアーキテクチャを使用している。

「ChatGPT」は、生成系AIの中でもテキスト生成系AIにカテゴライズされ、他のテキスト生成系AIとしてはGoogleの「Bard」、Bingの「Bing Chat」等が該当する。

この他にも画像生成AIや動画生成AI、音声生成AI等の生成系AIも登場しており、今後は印刷業界に限らず、業界団体が特定分野に特化したAIを開発することも考えられるなど、将来的な発展が注目される分野だ。

「ChatGPT」を始めとした生成系AIの特長はデータの学習方法にある。これまでのAIとは異なった、人間の評価による学習方法「RLHF」を用いて知識を身に着けている。「RLHF」とは、AIが学習した膨大なデータを人間が介入して評価する仕組みのことで、これによってAIのみによる自主学習以上の学習速度と客観的なフィードバックを得ることが出来るようになり、効率的な学習を行わせることが可能になった。

「ChatGPT」に限らず、生成系AIは多様な用途での活用が期待されている。例えば、質問応答、チャットボット、テキスト生成などでの運用、また、教育、カスタマーサポート、コンテンツ生成など、ビジネスや個人での使用も想定されている。

ただし、「ChatGPT」を使用するに当たって留意しなければならない点がある。それは、AIはあくまでプログラムに過ぎないため、人間のように感情や倫理的な判断を持っていないという点だ。

生成された回答の正否には注意が必要であり、回答の正確性や倫理性は人間の手で確認する必要がある。「ChatGPT」以前のAIでは、学習の過程でジェンダー、宗教、人種差別等の発言をするようになった事が問題にもなった。

生成される回答に関しても、完全に正確な内容になるのではなく、解答の正否の最終的な判断はあくまで質問を出した人間に委ねられるということも注意すべき点である。

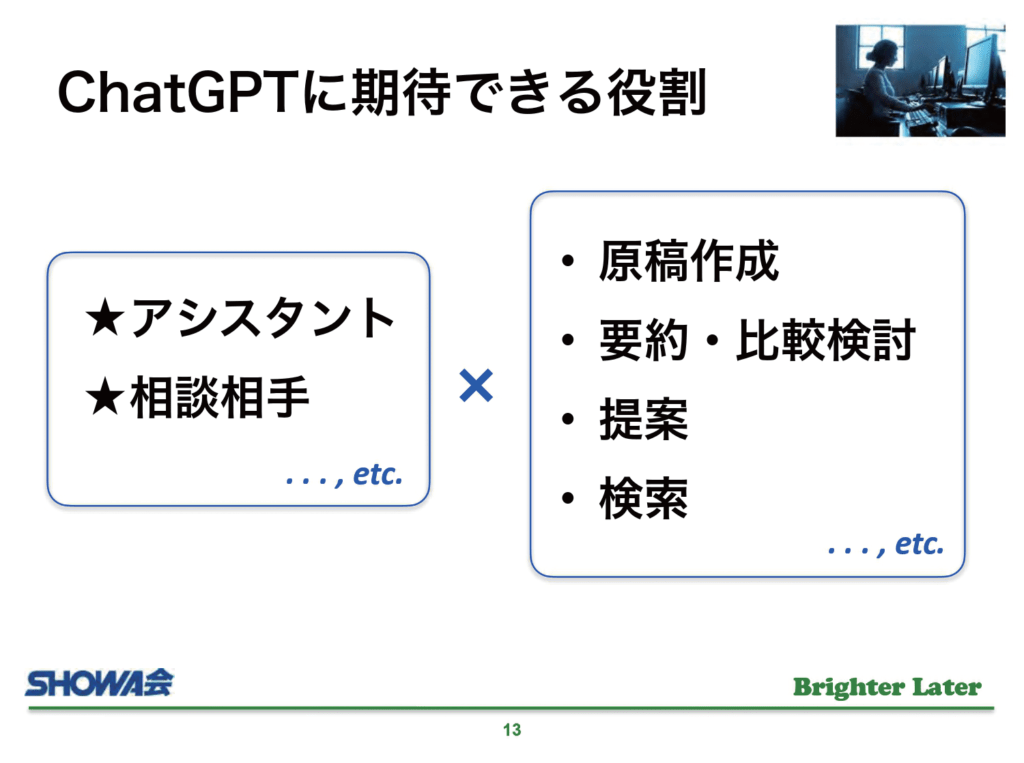

「ChatGPT」を始めとした生成系AIはあくまで先生として全ての正解を出してくれるのではなく、アシスタントや相談相手としての役割が主で、解答のヒントを出してくれるだけのものに過ぎない。例えば、原稿の作成、文章の要約・比較検討、提案、検索を行ってはくれるが、出された答えの正否を判断するのは、質問者に委ねられることになる。

そのため「ChatGPT」を使いこなして有用性を上げるためには「どのような質問を与えるか」に掛かっており、「ChatGPT」を理解できているかが重要である。

適切な応答をさせる責任は

利用者にある

「ChatGPT」はどのような質問に対しても適切に答えているようにも見えるかもしれない。しかし、基本的には「与えられた指示・前提・文脈・制約などを満たすように」言葉を紡ぐだけであるため、「ChatGPT」がユーザーにとって適切な応答ができるようにする責任は、利用するユーザー側にある。

「ChatGPT」はどのような質問に対しても適切に答えているようにも見えるかもしれない。しかし、基本的には「与えられた指示・前提・文脈・制約などを満たすように」言葉を紡ぐだけであるため、「ChatGPT」がユーザーにとって適切な応答ができるようにする責任は、利用するユーザー側にある。

質問した回答が支離滅裂なものになる場合、質問者が出した質問文に問題があることが多い。

そのため、適切な回答を出すために必要になるのが、「ChatGPT」への入力テキストに当たる「プロンプト」を適切な形で作成、入力をする「プロンプティング」の知識である。まず効率的なプロンプティングを行うコツは、前提分としての例を沢山掲示することである。質問の内容のみを入力し、例文や前提等を入力しない「ゼロショット」で質問した場合、支離滅裂な回答が返ってきてしまう。

一方で同じ質問であっても、質問の前提や例文を一つ加えた上で質問する「ワンショット」を行うだけで、前提の質問がない時より、回答の精度が上がる。 更には質問に対しての前提や文脈、制約などは一つだけを入れるのではなく、複数入れる「Few-Shot」を実行することでも精度も向上できる。

一方で、「ChatGPT」を持つ、独特な癖を把握することも重要である。質問の例を挙げて説明をする。 質問「私は市場に行って10個のリンゴを買いました。隣人に2つ、修理工に2つ渡しました。それから5つのリンゴを買って1つ食べました。残りは何個ですか?」

このまま「ChatGPT」に質問を入力すると、「ChatGPT」は支離滅裂な計算をしてしまい、正確な答えを反映させることができない。だが、この文章の最後に、「ステップバイステップで考えてみましょう」という一文を加えると、それだけで回答が変わり正確な回答が出るようになる。一文を入れただけで計算が変わってしまうのだ。

このような傾向は「ChatGPT」を含めた生成系AIの癖のような部分であり、実際に使用して確かめてみないと分からないものではある。しかし、繰り返して使用をして癖を掴み、適切な質問方法を考えることによって、自ずと正しい答えを導き出すことが出来るようになる。AIはあくまで道具である

「ChatGPT」は目まぐるしい学習と発展を遂げ、社会を変えようとしているが、登場してからまだ日は浅い。生成系AIは今後の発展と成長に期待ができる新技術ではあるものの、法整備がまだ不十分であり、活用に際しては細心の注意が必要である。

特に懸念されるものとしては、社外秘データを学習されてしまい、悪用されてしまう可能性があるという点だ。

「ChatGPTに入力した社外秘のデータはどう処理されるの?」と「ChatGPT」に質問すると、「公開されていない情報や、秘密情報などの機密情報を入力する場合、その情報はChatGPTに保存されることはありません」という回答を出す。しかし、入力した履歴を残したままにしてしまうと、社外秘の情報であっても保存してよい情報と捉えられて学習されてしまう可能性がある。これを回避するためには、質問した履歴が残らないように設定をする必要がある。

なお、同質問の回答では、「ただし、ChatGPTを使用する前に、秘密情報や機密情報を扱う前に、企業や組織の方針や規則に従って適切に取り扱う必要があります」とも述べられており、これは「ChatGPT」を始めとした生成系AIを使用するに当たって「どのような用途で使うのか」「明確にルールを定めて使用をするか」が利用するに当たって求められていることを指している。

だが現状として、企業は積極的に生成系AIの使用を推進してはいるものの、明確に使用方針を定めている企業や団体は少ない。機密情報の漏洩は基より、生成系AIで生成した著作物の著作権の所在など、現時点での問題点は幾つも存在している。今後生成系AIを使用するに当たっての明確な定義づけやルールを取り決めることは必須と言える。

生成AIの利用に関しては、学生がいち早く学んで使用するため、AIの使用に対して声明を出している大学がある。例として武蔵野美術大学と東京大学で掲示されたものを紹介する。

武蔵野美術大学の定めた見解で特徴的な点は、生成系AIの理解を深めることを促した上で、悪意ある情報の入力をしてはいけない旨を挙げていることである。この他、生成系AIの回答をそのまま用いることと、生成系AIで製作した作品を自分のものとして使用することを禁止している。なお、引用をする際には出典として生成系AIを用いたことを明記することも加えている。

これは、学生が社会に出て生成系AIの使用を想定してのものと考えられる他、AIで生成した画像の著作権の問題に対応したものであると見られる。

AI研究で知られる東京大学でも、生成系AI使用に当たる利用方針を明示している。こちらは、教員に対し授業での利用方針を定めるものである。

東京大学の利用方針として、生成系AIの使用の理解を深めることを促している点や、教員毎のスタンスを明示することなど、教員毎の認識を重要視していることが特徴として挙げられる。この他に、生成系AIによって容易に正解を出すことが出来ない課題を出すことを教員に求めている他、生徒に生成系AIを過信し過ぎないよう指導することを求めている。一方で教員に対しても、AIによって生成されたものを検出するツールはあるものの、これを過信しないようにする必要があることも明記しており、生成系AIの進歩に対して慢心してはいけないと述べている。

生成系AIはあくまで解答のみを出す「道具」でしかないという考えのもと、「課題解決のための力を養っていく」という課題を掲示すべき、というのが、東京大学のスタンスであると思われる。

二つの大学の利用方針は異なっているものの、今後企業や団体がAIの利用方針を定めるに当たって、大いに役に立つ例と言える。

実際に触れ、

自社サービスに取り込む

生成系AIの登場以降、AIを活用した事例が増えている。AIが最初から制作した出版物の登場や、飲料メーカーがイラスト生成系AIを用いたプロモーション画像を公開したように、AIの急速な進歩と共に、AIを用いたビジネス創出の機会が増えている。

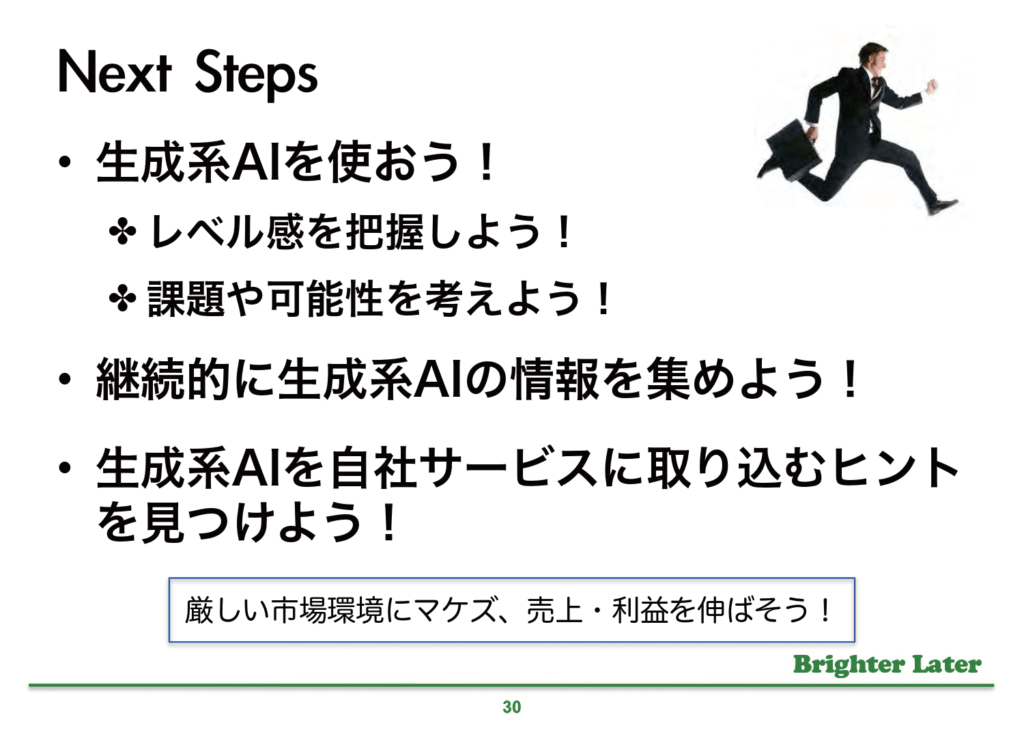

このような急変する社会の中で求められていることは、まず実際に現時点での生成系AIを使ってみることである。実際に使用して質問してみることによって、どのように運用をすれば、違和感のない指示を出すことが出来るかが見えてくる。

そのためにもまず、早めに生成系AIに触れ、レベル感や課題、可能性を考えていく必要がある。特に座学のみでは分からない生成系AIの癖を掴み、問題点を理解することによって、将来的に大きなビジネスに繋げていくことも出来る。

現状の生成系AIとの付き合い方として、まだよく分からないために使いにくい部分もあると思われるが、正しく恐れながら使うことが良いのではないかと考えられる。まずは触れて理解し、使用感を確かめることが重要である。

今後もAIの技術は進歩し、より発展的なものも登場することが考えられる。生成系AIを用いる主な用途はコスト削減である。常にAIの効率的な使い方を考えていき、事業の改善や発展に役立てていこうとする意識が求められてくる。